Модель искусственного нейрона

Адаптивные информационные системы

Потребность в адаптивных информационных системах возникает в тех случаях, когда поддерживаемые ими проблемные области постоянно развиваются. В связи с этим адаптивные системы должны удовлетворять ряду специфических требований, а именно:

• адекватно отражать знания проблемной области в каждый момент времени;

• быть пригодными для легкой и быстрой реконструкции при изменении проблемной среды.

Адаптивные свойства информационных систем обеспечиваются за счет интеллектуализации их архитектуры. Ядром таких систем является постоянно развиваемая модель проблемной области, поддерживаемая в специальной базе знаний – репозитории. Ядро системы управляет процессами генерации или переконфигурирования программного обеспечения.

В процессе разработки адаптивных информационных систем применяется оригинальное или типовое проектирование. Оригинальное проектирование предполагает разработку информационной системы с «чистого листа» на основе сформулированных требований. Реализация этого подхода основана на использовании систем автоматизированного проектирования, или CASE-технологий (Designer2000, SilverRun, Natural Light Storm и др.).

При типовом проектировании осуществляется адаптация типовых разработок к особенностям проблемной области. Для реализации этого подхода применяются инструментальные средства компонентного (сборочного) проектирования информационных систем (R/3, BAAN IV, Prodis и др.).

Главное отличие подходов состоит в том, что при использовании CASE-технологии каждый раз при изменении проблемной области выполняется генерация программного обеспечения в целом, а при использовании сборочной технологии – конфигурирование модулей и только в редких случаях – их переработка.

Тема 2. Искусственные нейронные сети. Архитектура и классификация нейронных сетей.

Представление о детальном устройстве головного мозга появилось только около ста лет назад. В 1888 г. испанский доктор Рамони Кайал экспериментально показал, что мозговая ткань состоит из большого числа связанных друг с другом однотипных узлов – нейронов. Более поздние исследования при помощи электронного микроскопа показали, что все нейроны, независимо от типа, имеют схожую организационную структуру (рис. 2.1). Естественная нервная клетка (нейрон) состоит из тела (сомы), содержащего ядро, и отростков – дендритов, по которым в нейрон поступают входные сигналы. Один из отростков, ветвящийся на конце, служит для передачи выходных сигналов данного нейрона другим нервным клеткам. Он называется аксоном. Соединение аксона с дендритом другого нейрона называется синапсом. Нейрон возбуждается и передает сигнал через аксон, если число пришедших по дендритам возбуждающих сигналов больше, чем число тормозящих.

Рисунок 2.1 – Строение биологического нейрона.

В 1943 г. В. Маккаллох и В. Питтс предложили систему обработки информации в виде сети, состоящей из простых вычислителей, созданных по принципу биологического нейрона. Искусственная нейронная сеть (ИНС) представляет собой совокупность простых вычислительных элементов (процессоров) – искусственных нейронов, соединенных некоторым образом так, чтобы между ними обеспечивалось взаимодействие. Искусственные нейроны характеризуются правилом комбинирования входных сигналов и передаточной функцией, позволяющим вычислить выходной сигнал.

Рисунок 2.2 – Кибернетическая модель нейрона.

Информация, поступающая на вход нейрона, суммируется с учетом весовых коэффициентов сигналов:

, (2.1)

, (2.1)

где w0 – сдвиг (порог, смещение) нейрона.

В зависимости от значения весового коэффициента wi, входной сигнал xi или усиливается, или подавляется. Взвешенную сумму входных сигналов также называют потенциалом или комбинированным входом нейрона.

Сдвиг обычно интерпретируется как связь, исходящая от элемента, активность которого всегда равна 1. Обычно, для удобства входной вектор расширяется добавлением этого сигнала до х = (1,х0,...,xn) и порог w0 вносится под знак суммы:

. (2.2)

. (2.2)

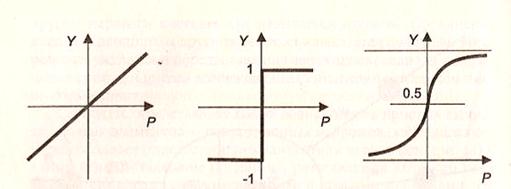

Передаточная функция, или функция активации нейрона, является правилом, согласно которому взвешенная сумма поступивших сигналов P преобразуется в выходной сигнал нейрона Y, который передается другим нейронам сети, т. е. Y=f(P). На рисунке 2.3 показаны графики наиболее распространённых функций активации нейронов.

Пороговая функция пропускает информацию только в том случае, если алгебраическая сумма входных сигналов превышает некоторую постоянную величину Р*, например:

Пороговая функция не обеспечивает достаточной гибкости ИНС при обучении. Если значение вычисленного потенциала не достигает заданного порога, то выходной сигнал не формируется и нейрон «не срабатывает». Это приводит к снижению интенсивности выходного сигнала нейрона и, как следствие, к формированию невысокого значения потенциала взвешенных входов в следующем слое нейронов.

Линейная функция дифференцируема и легко вычисляется, что в ряде случаев позволяет уменьшить ошибки выходных сигналов в сети, так как передаточная функция сети также является линейной. Однако она не универсальна и не обеспечивает решения многих задач.

Определенным компромиссом между линейной и ступенчатой функциями является сигмоидальная функция активации Y = 1/(1+exp(-kP)), которая удачно моделирует передаточную характеристику биологического нейрона (рис. 3.3, в).

а) б) в)

Рисунок 2.3 – Функции переноса искусственных нейронов:

а) линейная; б) ступенчатая; в) сигмоидальная.

Коэффициент k определяет крутизну нелинейной функции: чем больше k, тем ближе сигмоидальная функция к пороговой; чем меньше k, тем она ближе k линейной. Тип функции переноса выбирается с учетом конкретной задачи, решаемой с применением нейронных сетей. Например, в задачах аппроксимации и классификации предпочтение отдают сигмоидальной кривой.

Архитектура и классификация ИНС

С каждым нейроном связывается набор входящих связей, по которым к данному элементу поступают сигналы от других элементов сети, и набор исходящих связей, по которым сигналы данного элемента передаются другим нейронам. Некоторые нейроны предназначены для получения сигналов из внешней среды (входные элементы), а некоторые – для вывода во внешнюю среду результатов вычислений (выходные элементы).

В 1958 г. Фрэнк Розенблатт предложил следующую модель нейронной сети – персептрона. Персептрон Розенблатта (рис. 2.4) состоит из k нейронов, имеет d входов, k выходов и только один слой настраиваемых весов wij.

Рисунок 2.4 – Персептрон Розенблатта.

Входные нейроны обычно предназначены для распределения вводимых сигналов между другими нейронами сети, поэтому для них требуется, чтобы исходящий от элемента сигнал был таким же, как и входящий. В отличие от других нейронов сети, входные имеют только по одному входу. Иными словами, каждый входной элемент может получать сигнал от одного соответствующего ему датчика. Поскольку входные элементы предназначены исключительно для того, чтобы распределять сигналы, получаемые из внешней среды, многие исследователи вообще не считают входные элементы частью нейронной сети.

Персептрон способен решать линейные задачи. Число входов сети определяет размерность пространства, из которого выбираются входные данные: для двух признаков пространство оказывается двумерным, для трех – трехмерным, а для d признаков – d-мерным. Если прямая или гиперплоскость в пространстве входных данных может разделить все образцы на соответствующие им классы, то проблема является линейной, в противном случае – нелинейной. На рисунке 2.5 показаны множества точек на плоскости, причём в случае а) граница линейная, в случае – б) нелинейная.

а) б)

Рисунок 2.5 – Геометрическое представление линейной (а) и

нелинейной (б) задач.

Для решения нелинейных проблем предложены модели многослойных персептронов (MLP), способные строить ломаную границу между распознаваемыми образами. В многослойных сетях каждый нейрон может посылать выходной сигнал только в следующий слой и принимать входные сигналы только с предыдущего слоя, как показано на рисунке 2.6. Слои нейронов, расположенные между входным и выходным называются скрытыми, так как не получают и не передают данные непосредственно из внешней среды. Такая сеть позволяет выделять глобальные свойства данных за счет наличия дополнительных синаптических связей и повышения уровня взаимодействия нейронов.

Рисунок 2.6 – Схема многослойного персептрона.

Определение числа скрытых слоев и числа нейронов в каждом слое для конкретной задачи является неформальной проблемой, при решении которой можно использовать эвристическое правило: число нейронов в следующем слое в два раза меньше, чем в предыдущем

В настоящее время кроме многослойного персептрона существует множество способов задания структур нейронных сетей. Все виды нейронных сетей можно условно разделить на сети прямого распространения и сети с обратными связями. Как следует из названия, в сетях первого типа сигналы от нейрона к нейрону распространяются в четко заданном направлении – от входов сети к ее выходам. В сетях второго типа выходные значения любого нейрона сети могут передаваться к его же входам. Это позволяет нейронной сети моделировать более сложные процессы, например временные, но делает выходы подобной сети нестабильными, зависящими от состояния сети на предыдущем цикле. На рисунке 2.7. представлена классификация наиболее распространенных типов нейронных сетей.

Рисунок 2.7 – Классификация распространённых видов ИНС.

Тема 3. Сети типа персептрон

Задача классификации образов. Обучение с учителем

Ф. Розенблатт предложил использовать персептрон для задач классификации. Многие приложения можно интерпретировать, как проблемы классификации. Например, оптическое распознавании символов. Отсканированные символы ассоциируются с соответствующими им классами. Имеется немало вариантов изображения буквы "Н" даже для одного конкретного шрифта – символ может оказаться, например, смазанным, – но все эти изображения должны принадлежать классу "Н".

Когда известно, к какому классу относится каждый из учебных примеров, можно использовать стратегию обучения с учителем. Задачей для сети является ее обучение тому, как сопоставить предъявляемый сети образец с контрольным целевым образцом, представляющим нужный класс. Иными словами, знания об окружающей среде представляются нейронной сети в виде пар "вход-выход". Например, сети можно предъявить изображение буквы "Н" и обучить сеть тому, что при этом соответствующий "Н" выходной элемент должен быть включен, а выходные элементы, соответствующие другим буквам – выключены. В этом случае входной образец может быть набором значений, характеризующих пиксели изображения в оттенках серого, а целевой выходной образец – вектором, значения всех координат которого должны быть равными 0, за исключением координаты, соответствующей классу "Н", значение которой должно быть равным.

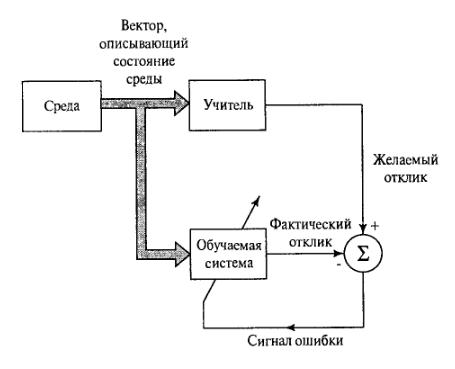

На рисунке 3.1 показана блочная диаграмма, иллюстрирующая эту форму обучения. Предположим, что учителю и обучаемой сети подается обучающий вектор из окружающей среды. На основе встроенных знаний учитель может сформировать и передать обучаемой нейронной сети желаемый отклик, соответствующий данному входному вектору. Параметры сети корректируются с учетом обучающего вектора и сигнала ошибки. Сигнал ошибки – это разность между желаемым сигналом и текущим откликом нейронной сети. После окончания обучения учителя можно отключить и позволить нейронной сети работать со средой самостоятельно.

Рисунок 3.1 – Концепция обучения ИНС с учителем.

Алгоритм обучения перцептрона включает следующие шаги:

· Системе предъявляется эталонный образ.

· Если результат распознавания совпадает с заданным, весовые коэффициенты связей не изменяются.

· Если ИНС неправильно распознает результат, то весовым коэффициентам дается приращение в сторону повышения качества распознавания.